Chapitre 13 — Service mesh et réseau avancé#

Dans une architecture microservices, la communication entre services devient rapidement un problème transversal : comment garantir le chiffrement bout-en-bout, gérer les retry, détecter les services défaillants, ou observer les flux ? Le service mesh répond à ces besoins en extrayant la logique réseau de chaque service vers une couche d’infrastructure dédiée.

Problèmes résolus par un service mesh#

Sans service mesh, chaque équipe doit implémenter dans son code :

Observabilité réseau : traces distribuées, métriques de latence, taux d’erreur par paire de services

Sécurité : chiffrement TLS mutuel (mTLS) entre services, rotation des certificats

Résilience : retry avec backoff exponentiel, timeout, circuit-breaker

Gestion du trafic : canary releases, A/B testing, rate limiting

Ces fonctionnalités sont cross-cutting : les implémenter dans chaque service crée de la duplication, des incohérences et un couplage fort avec les bibliothèques réseau. Le service mesh déplace cette complexité au niveau de l’infrastructure.

Le problème du « code réseau partout »

Dans un système avec 50 microservices écrits en Go, Java, Python et Node.js, maintenir une bibliothèque de résilience cohérente dans chaque langage est une charge colossale. Le service mesh offre une solution language-agnostique.

Architecture : control plane et data plane#

Un service mesh se divise en deux plans :

Data plane — traite le trafic réseau réel :

Un sidecar proxy (généralement Envoy) est injecté à côté de chaque pod

Tout le trafic entrant et sortant du pod transite par ce proxy

Le proxy applique les politiques de sécurité, collecte les métriques, gère les retry

Control plane — configure les proxies :

Maintient la configuration centralisée (règles de routage, certificats, politiques)

Distribue dynamiquement la configuration aux proxies via des API (xDS pour Envoy)

Ne touche jamais au trafic applicatif directement

Le pattern sidecar

Le sidecar est un conteneur supplémentaire dans le même pod Kubernetes. Il partage le namespace réseau du pod principal (même interface réseau, même adresse IP). Le proxy intercepte tout le trafic via des règles iptables sans que l’application le sache.

Istio en détail#

Istio est le service mesh le plus complet et le plus répandu. Sa version 1.x a unifié l’architecture autour d’un seul composant control plane : istiod.

Composants#

istiod : processus unique combinant Pilot (configuration des proxies), Citadel (PKI/certificats), et Galley (validation de configuration)

Envoy : proxy data plane, chaque instance est configurée par istiod via les API xDS (CDS, EDS, LDS, RDS)

Prometheus + Grafana + Kiali + Jaeger : intégrés dans le addon stack pour l’observabilité

Installation#

# Télécharger istioctl

curl -L https://istio.io/downloadIstio | sh -

export PATH=$PATH:$PWD/istio-1.20.0/bin

# Installer avec le profil demo (développement)

istioctl install --set profile=demo -y

# Vérifier l'installation

istioctl verify-install

# Activer l'injection automatique dans le namespace default

kubectl label namespace default istio-injection=enabled

Injection automatique du sidecar#

Quand istio-injection=enabled est défini sur un namespace, le mutating webhook d’Istio intercepte chaque création de pod et injecte automatiquement le conteneur Envoy. Le pod passe de 1 à 2 conteneurs (plus les init containers de configuration iptables).

Traffic management Istio#

Istio introduit quatre ressources Custom Resource Definitions (CRD) pour la gestion du trafic :

VirtualService#

Définit comment router le trafic vers un service — routing basé sur les headers, le poids, le chemin URI.

apiVersion: networking.istio.io/v1beta1

kind: VirtualService

metadata:

name: reviews

spec:

hosts:

- reviews

http:

- match:

- headers:

end-user:

exact: "test-user"

route:

- destination:

host: reviews

subset: v3

- route:

- destination:

host: reviews

subset: v1

weight: 90

- destination:

host: reviews

subset: v3

weight: 10

DestinationRule#

Définit les politiques appliquées après le routage : load balancing, mTLS, circuit-breaker, pool de connexions.

apiVersion: networking.istio.io/v1beta1

kind: DestinationRule

metadata:

name: reviews

spec:

host: reviews

trafficPolicy:

connectionPool:

tcp:

maxConnections: 100

http:

http1MaxPendingRequests: 1

maxRequestsPerConnection: 1

outlierDetection:

consecutiveGatewayErrors: 5

interval: 30s

baseEjectionTime: 30s

maxEjectionPercent: 100

subsets:

- name: v1

labels:

version: v1

- name: v3

labels:

version: v3

Gateway et ServiceEntry#

Gateway : expose des services vers l’extérieur du mesh (remplace l’Ingress Kubernetes pour les fonctions avancées)

ServiceEntry : enregistre des services externes dans le registre Istio pour leur appliquer des politiques mTLS, retry, timeout

Fault injection#

Istio permet d’injecter des fautes en staging — ou en production avec prudence — pour tester la résilience sans modifier le code applicatif.

apiVersion: networking.istio.io/v1beta1

kind: VirtualService

metadata:

name: ratings

spec:

hosts:

- ratings

http:

- fault:

delay:

percentage:

value: 10.0

fixedDelay: 5s

abort:

percentage:

value: 5.0

httpStatus: 503

route:

- destination:

host: ratings

subset: v1

Cette configuration injecte un délai de 5 secondes sur 10 % des requêtes et retourne un 503 sur 5 % — permettant de valider que les services en amont gèrent correctement ces situations dégradées.

Canary release via Istio#

Le déploiement canary avec Istio est plus fin qu’avec les Deployments Kubernetes natifs car il opère au niveau du trafic HTTP, indépendamment du nombre de pods.

# 2 versions déployées : reviews-v1 (3 replicas), reviews-v2 (1 replica)

# Istio route 90 % vers v1, 10 % vers v2 — indépendamment des replicas

apiVersion: networking.istio.io/v1beta1

kind: VirtualService

metadata:

name: reviews

spec:

hosts:

- reviews

http:

- route:

- destination:

host: reviews

subset: v1

weight: 90

- destination:

host: reviews

subset: v2

weight: 10

La progression se fait en modifiant uniquement les poids : 80/20 → 50/50 → 0/100, puis suppression de v1 et de sa DestinationRule.

Linkerd : l’alternative légère#

Linkerd (v2) est un service mesh conçu pour la simplicité et la performance. Son proxy data plane est écrit en Rust (linkerd2-proxy), ce qui lui confère une empreinte mémoire très faible et une latence minimale.

Architecture Linkerd#

Control plane :

linkerd-destination(découverte de services),linkerd-identity(certificats mTLS),linkerd-proxy-injector(webhook d’injection)Data plane : linkerd2-proxy — un proxy Rust ultra-léger, sans configuration manuelle (opaque par design, pas de VirtualService ni de DestinationRule)

Viz extension : tableau de bord, métriques Prometheus, Grafana intégrés

Installation Linkerd#

# Vérifier la compatibilité du cluster

linkerd check --pre

# Installer les CRDs puis le control plane

linkerd install --crds | kubectl apply -f -

linkerd install | kubectl apply -f -

# Vérifier l'état

linkerd check

# Annoter un namespace pour l'injection automatique

kubectl annotate namespace default linkerd.io/inject=enabled

Use cases Linkerd#

Linkerd excelle quand :

La performance prime (proxies Rust avec overhead < 1 ms)

L’équipe est petite et ne veut pas opérer la complexité d’Istio

Les fonctionnalités avancées de routage L7 (fault injection, traffic mirroring) ne sont pas nécessaires

Le cluster est multi-tenant et l’isolation des namespaces est critique

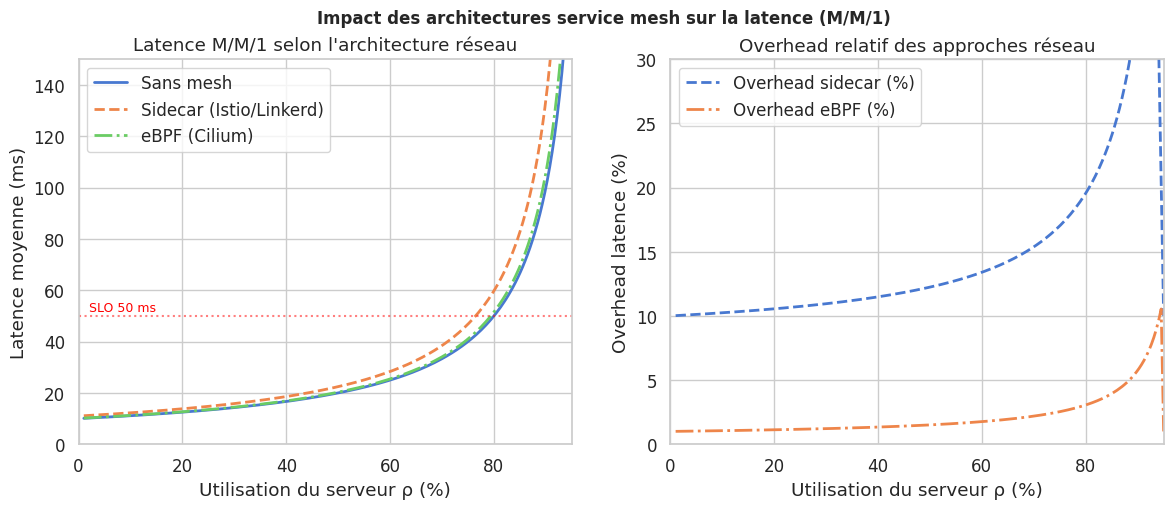

eBPF et service meshes sans sidecar#

Le modèle sidecar a un coût : latence additionnelle, consommation mémoire (50–100 Mo par pod), et complexité opérationnelle. L”eBPF (extended Berkeley Packet Filter) ouvre une nouvelle voie en exécutant du code directement dans le kernel Linux.

Cilium#

Cilium remplace kube-proxy et le CNI standard par un dataplane eBPF. Il peut implémenter des fonctionnalités de service mesh directement dans le kernel, sans sidecar.

Fonctionnalités : network policies L3/L4/L7, observabilité Hubble, mTLS avec SPIFFE/SPIRE

Avantages : pas de sidecar, overhead minimal, visibilité au niveau kernel

Limites : nécessite un kernel Linux récent (≥ 5.10), débogage plus complexe

Ambient Mesh (Istio sans sidecar)#

Istio Ambient Mode (disponibilité générale depuis Istio 1.22) élimine les sidecars via :

ztunnel : un proxy par nœud (DaemonSet) gérant le chiffrement mTLS et l’observabilité L4

waypoint proxy : un proxy par namespace ou service account pour les fonctionnalités L7 avancées (routage, fault injection)

Ce modèle réduit drastiquement l’overhead tout en conservant les fonctionnalités Istio.

eBPF et sécurité

eBPF permet d’exécuter du code non privilégié dans le kernel via un vérificateur statique. C’est une avancée majeure pour les outils d’observabilité et de sécurité réseau, mais la complexité de débogage augmente : les programmes eBPF ne génèrent pas de stack traces classiques.

Simulation : latence sidecar selon la charge (modèle M/M/1)#

import numpy as np

import matplotlib.pyplot as plt

import matplotlib.patches as mpatches

import seaborn as sns

sns.set_theme(style="whitegrid", palette="muted", font_scale=1.1)

def mm1_latency_ms(rho, service_time_ms=10):

"""Latence moyenne M/M/1 en ms pour un taux d'utilisation rho donné."""

if rho >= 1:

return np.inf

return service_time_ms / (1 - rho)

rho_values = np.linspace(0.01, 0.95, 200)

# Sans service mesh : service_time = 10 ms

latency_no_mesh = np.array([mm1_latency_ms(r, service_time_ms=10) for r in rho_values])

# Avec sidecar Istio/Linkerd : deux sauts proxy (+0.5 ms chacun) → service_time = 11 ms

# et légère pression CPU → rho augmente de ~2 %

latency_sidecar = np.array([

mm1_latency_ms(min(r * 1.02, 0.95), service_time_ms=11) for r in rho_values

])

# Avec eBPF (Cilium) : overhead quasi nul (~0.1 ms)

latency_ebpf = np.array([

mm1_latency_ms(min(r * 1.005, 0.95), service_time_ms=10.1) for r in rho_values

])

fig, axes = plt.subplots(1, 2, figsize=(14, 5))

ax1 = axes[0]

ax1.plot(rho_values * 100, latency_no_mesh, label="Sans mesh", linewidth=2)

ax1.plot(rho_values * 100, latency_sidecar, label="Sidecar (Istio/Linkerd)", linewidth=2, linestyle="--")

ax1.plot(rho_values * 100, latency_ebpf, label="eBPF (Cilium)", linewidth=2, linestyle="-.")

ax1.set_xlim(0, 95)

ax1.set_ylim(0, 150)

ax1.set_xlabel("Utilisation du serveur ρ (%)")

ax1.set_ylabel("Latence moyenne (ms)")

ax1.set_title("Latence M/M/1 selon l'architecture réseau")

ax1.axhline(y=50, color="red", linestyle=":", alpha=0.5)

ax1.annotate("SLO 50 ms", xy=(2, 52), color="red", fontsize=9)

ax1.legend()

ax2 = axes[1]

overhead_sidecar = (latency_sidecar - latency_no_mesh) / latency_no_mesh * 100

overhead_ebpf = (latency_ebpf - latency_no_mesh) / latency_no_mesh * 100

ax2.plot(rho_values * 100, overhead_sidecar, label="Overhead sidecar (%)", linewidth=2, linestyle="--")

ax2.plot(rho_values * 100, overhead_ebpf, label="Overhead eBPF (%)", linewidth=2, linestyle="-.")

ax2.set_xlim(0, 95)

ax2.set_ylim(0, 30)

ax2.set_xlabel("Utilisation du serveur ρ (%)")

ax2.set_ylabel("Overhead latence (%)")

ax2.set_title("Overhead relatif des approches réseau")

ax2.legend()

plt.suptitle("Impact des architectures service mesh sur la latence (M/M/1)", fontsize=12, fontweight="bold")

plt.show()

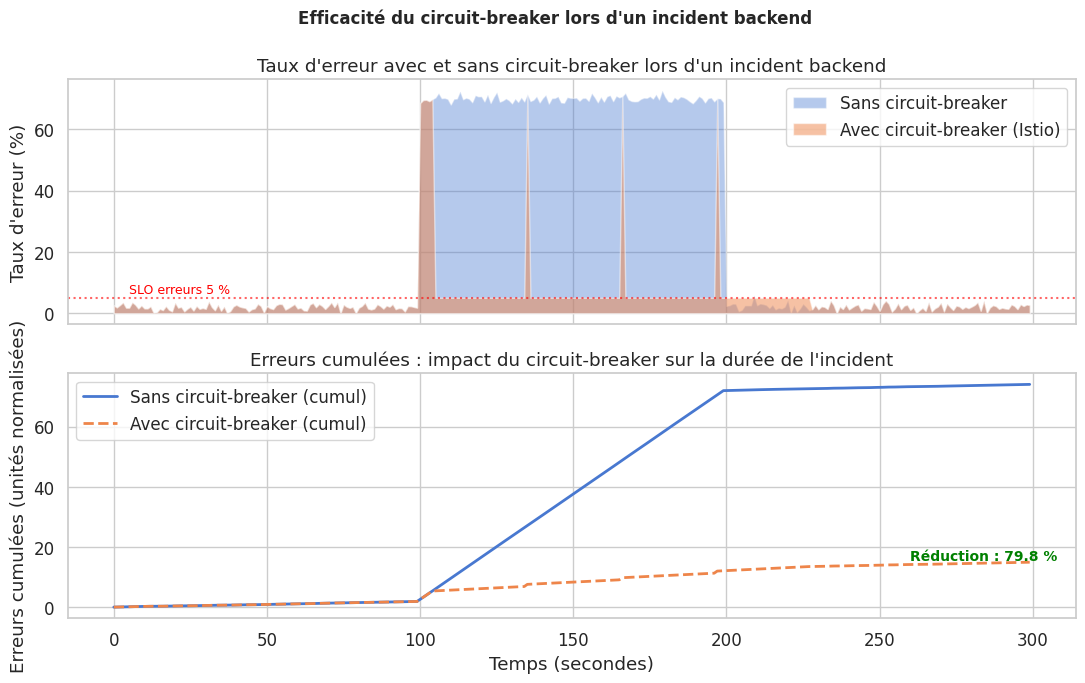

Simulation : gain de fiabilité avec circuit-breaker#

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

sns.set_theme(style="whitegrid", palette="muted", font_scale=1.1)

np.random.seed(42)

duration = 300

t = np.arange(duration)

# Taux d'erreur backend : pic de 70 % entre t=100 et t=200

backend_errors = np.where((t >= 100) & (t < 200), 0.70, 0.02)

backend_errors = (backend_errors + np.random.normal(0, 0.01, duration)).clip(0, 1)

# Sans circuit-breaker : toutes les erreurs remontent

errors_no_cb = backend_errors.copy()

# Avec circuit-breaker Istio (outlierDetection)

# Seuil : >50 % d'erreurs sur 5s → OPEN pendant 30s

errors_with_cb = np.zeros(duration)

cb_state = "CLOSED"

cb_open_since = 0

window = 5

for i in range(duration):

if cb_state == "OPEN":

if i - cb_open_since >= 30:

cb_state = "CLOSED"

errors_with_cb[i] = 0.05 # fast-fail : réponse immédiate, pas de cascade

else:

errors_with_cb[i] = backend_errors[i]

if i >= window and backend_errors[i - window:i].mean() > 0.5:

cb_state = "OPEN"

cb_open_since = i

fig, axes = plt.subplots(2, 1, figsize=(13, 7), sharex=True)

ax1 = axes[0]

ax1.fill_between(t, errors_no_cb * 100, alpha=0.4, label="Sans circuit-breaker")

ax1.fill_between(t, errors_with_cb * 100, alpha=0.5, label="Avec circuit-breaker (Istio)")

ax1.set_ylabel("Taux d'erreur (%)")

ax1.set_title("Taux d'erreur avec et sans circuit-breaker lors d'un incident backend")

ax1.axhline(y=5, color="red", linestyle=":", alpha=0.6)

ax1.annotate("SLO erreurs 5 %", xy=(5, 6.5), color="red", fontsize=9)

ax1.legend()

ax2 = axes[1]

cumul_no_cb = np.cumsum(errors_no_cb)

cumul_with_cb = np.cumsum(errors_with_cb)

ax2.plot(t, cumul_no_cb, label="Sans circuit-breaker (cumul)", linewidth=2)

ax2.plot(t, cumul_with_cb, label="Avec circuit-breaker (cumul)", linewidth=2, linestyle="--")

ax2.set_xlabel("Temps (secondes)")

ax2.set_ylabel("Erreurs cumulées (unités normalisées)")

ax2.set_title("Erreurs cumulées : impact du circuit-breaker sur la durée de l'incident")

reduction = (cumul_no_cb[-1] - cumul_with_cb[-1]) / cumul_no_cb[-1] * 100

ax2.annotate(f"Réduction : {reduction:.1f} %",

xy=(260, cumul_with_cb[-1] + 0.5),

fontsize=10, color="green", fontweight="bold")

ax2.legend()

plt.suptitle("Efficacité du circuit-breaker lors d'un incident backend", fontsize=12, fontweight="bold")

plt.show()

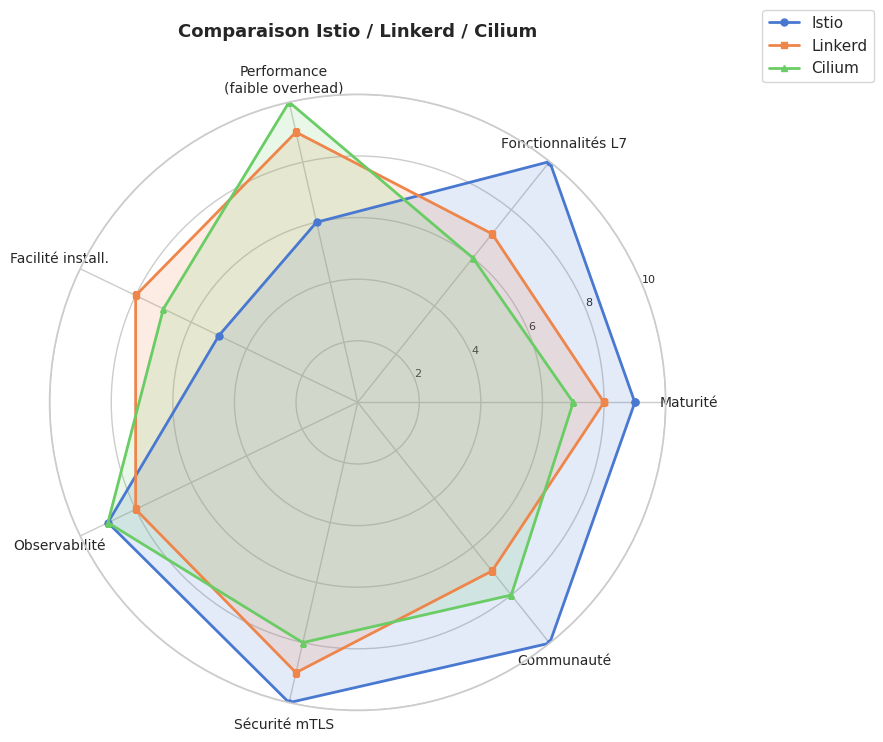

Radar chart comparatif : Istio vs Linkerd vs Cilium#

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

sns.set_theme(style="whitegrid", palette="muted", font_scale=1.1)

categories = [

"Maturité", "Fonctionnalités L7", "Performance\n(faible overhead)",

"Facilité install.", "Observabilité", "Sécurité mTLS", "Communauté"

]

N = len(categories)

# Scores sur 10 — représentatifs des forces et faiblesses de chaque solution

istio = [9, 10, 6, 5, 9, 10, 10]

linkerd = [8, 7, 9, 8, 8, 9, 7]

cilium = [7, 6, 10, 7, 9, 8, 8]

def close(lst):

return lst + [lst[0]]

angles = [n / float(N) * 2 * np.pi for n in range(N)]

angles_p = angles + [angles[0]]

fig, ax = plt.subplots(figsize=(8, 8), subplot_kw=dict(polar=True))

ax.plot(angles_p, close(istio), "o-", linewidth=2, label="Istio", markersize=5)

ax.fill(angles_p, close(istio), alpha=0.15)

ax.plot(angles_p, close(linkerd), "s-", linewidth=2, label="Linkerd", markersize=5)

ax.fill(angles_p, close(linkerd), alpha=0.15)

ax.plot(angles_p, close(cilium), "^-", linewidth=2, label="Cilium", markersize=5)

ax.fill(angles_p, close(cilium), alpha=0.15)

ax.set_xticks(angles)

ax.set_xticklabels(categories, size=10)

ax.set_ylim(0, 10)

ax.set_yticks([2, 4, 6, 8, 10])

ax.set_yticklabels(["2", "4", "6", "8", "10"], size=8)

ax.set_title("Comparaison Istio / Linkerd / Cilium", size=13, fontweight="bold", pad=20)

ax.legend(loc="upper right", bbox_to_anchor=(1.35, 1.15), fontsize=11)

plt.show()

Quand utiliser un service mesh#

L’adoption d’un service mesh implique un coût opérationnel réel. Voici une analyse honnête des critères :

Adopter un service mesh quand :

Plus de 10 services communiquant entre eux en production

mTLS obligatoire entre services (conformité PCI-DSS, HIPAA, SOC 2)

Besoin de déploiements canary ou A/B testing au niveau réseau

Observabilité distribuée insuffisante avec les solutions existantes

L’équipe a la maturité opérationnelle pour gérer le control plane

Ne pas adopter quand :

Architecture monolithique ou très peu de services (< 5)

Équipe SRE absente ou de taille inférieure à 3 personnes

Latence très contrainte (trading haute fréquence, temps réel strict)

Kubernetes non utilisé — Istio et Linkerd sont Kubernetes-natifs

Complexité opérationnelle d’Istio

Istio ajoute des CRDs, des webhooks, des certificats et ses propres procédures de mise à jour. Une mauvaise configuration d’une VirtualService peut silencieusement blackholer du trafic. Les outils de diagnostic istioctl analyze et Kiali sont indispensables pour opérer Istio en production.

Résumé#

Un service mesh externalise les préoccupations transversales réseau (sécurité, observabilité, résilience) hors du code applicatif, grâce à des proxies sidecar transparents.

L’architecture se divise en control plane (configuration, certificats, policy) et data plane (proxies qui traitent le trafic en temps réel).

Envoy est le proxy de référence : utilisé par Istio, AWS App Mesh et Consul Connect, il expose les API xDS pour la configuration dynamique.

Istio offre le jeu de fonctionnalités le plus complet — VirtualService, DestinationRule, fault injection, traffic mirroring — au prix d’une complexité opérationnelle élevée.

Linkerd (proxy Rust) est l’alternative légère avec 2 à 3 fois moins d’overhead mémoire, idéale pour les petites équipes sans besoin de routage L7 avancé.

eBPF (Cilium, Ambient Mesh) déplace l’implémentation du mesh dans le kernel Linux sans sidecar, réduisant drastiquement l’overhead et simplifiant le modèle de déploiement.

Le circuit-breaker (outlierDetection dans Istio) protège les services en amont en éjectant rapidement les instances défaillantes — la simulation montre une réduction significative des erreurs cumulées.

Les canary releases Istio opèrent sur des poids de trafic HTTP, indépendamment du nombre de replicas — bien plus granulaire que le rolling update natif Kubernetes.

La fault injection en production contrôlée (délais, erreurs HTTP) permet de valider la résilience des systèmes sans modifier le code — pratique centrale du chaos engineering.

L’adoption d’un service mesh est justifiée à partir de ~10 services avec des exigences réelles de sécurité inter-services ou d’observabilité distribuée avancée.